目次

はじめに

こんにちは。橋本ゼミ12期生の束田、百合岡です。今年の大学祭で、私たちはAIを用いた手相「占い」を行いました。具体的には、参加者の手の画像を撮影し、それをChat GPTに入力して占い結果を得ました。この手相占いを通じて、私たちはAIと人間の信頼関係について興味を持ちました。

この記事では、人はなぜAIを信じるのかについて考えていきます。

AIによる「占い」

Chat GPTとは?

Chat GPTはアメリカのAI研究所であるOpenAIにより開発されたAIチャットボットです。まるで人間が書いたような自然な文章と高精度な回答により、話題となっています。

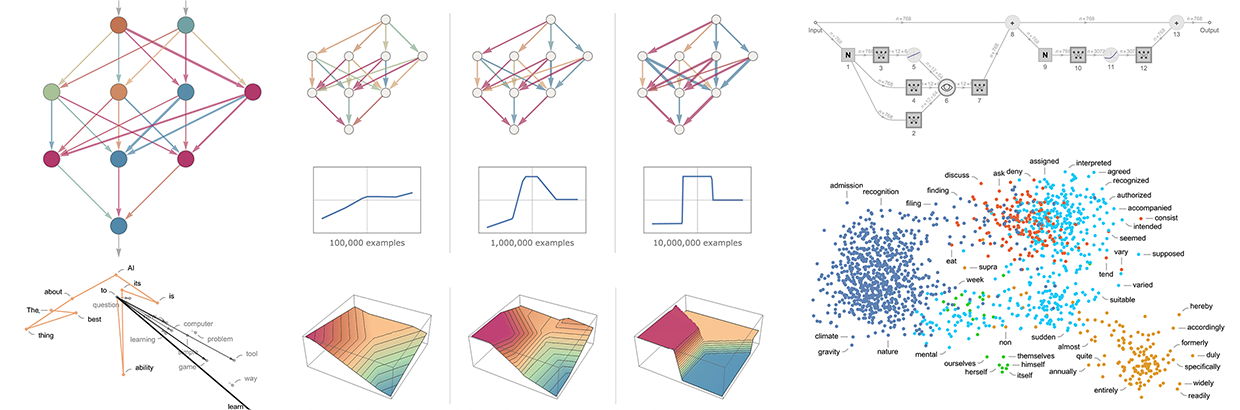

ChatGPTは、大量のテキストデータを学習して、人間のような文章を生成するAIです。インターネット上の何十億ものページから、特定の文章の後にどのような単語が続くかを学習しています。質問をすると与えられた文章に基づいて、次に来る単語の「確率」を計算し、その確率に基づいて次の単語を選びます。しかし、常に最も高い確率の単語を選ぶのではなく、時にはランダムに他の単語を選ぶことで、より自然で興味深い文章を生成するようになっています。このプロセスを繰り返すことで、ChatGPTは人間のような文章を作り出すことができるのです。

「占い」について考える

Chat GPTの仕組みについての理解を深めた上で、次に占いに焦点を当てます。先に述べたChat GPTの動作原理を踏まえると、AIが生成したのは一般的な占いとは異なり、占い風に出力したただの文字列であることが理解できます。ここでの一般的な占いとは、個人の情報を基に特定の手法で未来の出来事を予測する行為を指します。例えば、手相占いやタロットカード、四柱推命などが挙げられます。

人はなぜAIを信じるのか

私たちが大学祭で手相占いを行った際、参加者にアンケートに答えてもらいました。そのアンケート結果を確認すると、50人中27人がAI 占いを信じると回答しました。ではなぜ、本当の占いをしていないにも関わらず、人々は信じたのでしょうか?

主に3つの理由があると私達は考えました。

まず、1つ目の理由としてAIの精度が挙げられます。2-1で述べたように、AIは学習データから確率に基づいて単語を選び、文章を生成します。これにより、AIが単にそれらしい文章を書くだけの存在と誤解されることもあるかもしれません。しかし、実際には、大量のデータを学習し、記憶し、判断する能力がAIの強みであり、特に知識に基づく問題においては非常に優れています。以下に具体的な例をいくつか挙げます。

脳腫瘍の診断では、脳腫瘍の画像診断においてAIがプロの医師よりも優れていることが示されています。具体的には、15人のベテラン医師は66%の精度で診断しましたが、BioMindというAIは87%の精度で診断しました。また、脳内の血腫拡大の予測では、ベテラン医師の診断精度は63%であるのに対し、BioMindは83%の精度を達成しました。

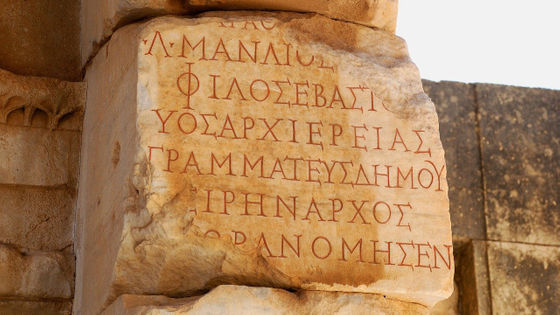

碑文解読の分野では、DeepMindの碑文解読AI「Ithaca」が古代ギリシャの断片化した碑文を復元しました。Ithacaは単体で62%の精度で碑文を復元し、考古学者がIthacaを使用することで精度は72%に向上しました。さらに、Ithacaは碑文が執筆された年代を平均して30年の誤差で推定し、碑文の起源を71%の確率で特定しました。

法律分野においても、AIが法律家よりも優れていることが示されています。具体的には、AIは94%の精度で秘密保持契約書を処理しましたが、弁護士20人の平均は85%でした。処理速度においても、弁護士20人の平均処理時間は92分であるのに対し、AIはわずか26秒で処理を完了しました。

これらの例では、プロを超える精度を叩き出したAI もあります。このようなAIの高い精度が人々の信頼を得る要因であることがわかります。しかし、知識に基づく問題であっても間違いがあることを忘れず、鵜呑みにせず注意が必要です。

次に2つ目の理由としてAIが、何を根拠に回答しているかわからないことが挙げられます。AIの進化の歴史を振り返ると、ディープラーニング以前のAIは、専門家の知恵や技能の手順を人の手によってプログラム化していました。しかし、ディープラーニングの台頭により、AI 自ら学習するようになると判断のルールがブラックボックス化し、人間には理解しづらくなったのです。現在のAIは、多数のパラメータを駆使して複雑な判断を下しますが、その理由を人間が理解することはほぼ不可能です。そのため、AIの回答が正確であることが多いにもかかわらず、その根拠は明示されない「ブラックボックス化」された性質がAIにあるため、AIは異質な知性として捉えられ、その神秘性や権威が信頼感を生んでいるのです。例えば、将棋の世界では、プロ棋士や観戦者が将棋ソフトの評価値を信頼し、それを基準に判断するようになっています。つまり、将棋の世界ではAIの回答が専門家のそれと同等、あるいはそれ以上の権威を持つようになっているのです。

3つ目の理由として、人々のAIに対する意識がAI占いを信じるに至らしめたと考えます。

私たちはアンケートでAI占いを信じると答えた人に、さらに追加でAI占いを信じる理由を答えてもらいました。その結果、信じる理由として「何かをもとに解読していると思うため」「AIのほうが人よりもいろいろなことを知っているから。」などといった回答が多く得られました。これらの回答から参加者はAIの精度を信用していることがわかりました。加えて学習データがブラックボックスなため、AIは占いのデータを学習していると判断する人が多かったと考えられます。

最後に

AIが出した答えの根拠が分からないということは誤った判断の原因が究明しにくいため、改善が困難です。そのため、今後もこの問題に対処する必要があるでしょう。また、採用選考や医療診断など、判断の根拠を知りたい場面では、AIのブラックボックス化が問題となります。そのため私達は専門知識やAI の仕組みについて学び、AIとうまく共存していく必要があります。

参考文献

伊藤 元昭、第1回:説明もせず、責任も取らない機械を信じられますか? (1/4) 連載02 ブラックボックスなAIとの付き合い方、Telescope Magazine、2019/8/30

Stephen Wolfram、What Is ChatGPT Doing … and Why Does It Work?、Stephen Wolfram Writings、2023/2/14

AI Lab 編集部 | Contributor、AI研究における「ブラックボックス問題」とは何か 、 Forbes JAPAN 公式サイト、2018/2/20

Qbook編集部、AIの「ブラックボックス問題」と求められる信頼性|、Qbook、2022/10/25

AIがベテラン医師よりも高精度に脳スキャン画像から脳腫瘍を診断することに成功、GIGAZINE、2018/7/4

DeepMindの碑文解読AI「Ithaca」で失われた碑文を72%の精度で復元することに成功、GIGAZINE、2022/3/11

弁護士よりもAIの方が秘密保持契約書(NDA)の処理を素早く正確に行える、GIGAZINE、2018/11/5

執筆 : 橋本ゼミ12期生 束田大空、百合岡駿也